Construyendo IA Agéntica Confiable: una Introducción y Retos Abiertos

Dr. Pedro Saleiro

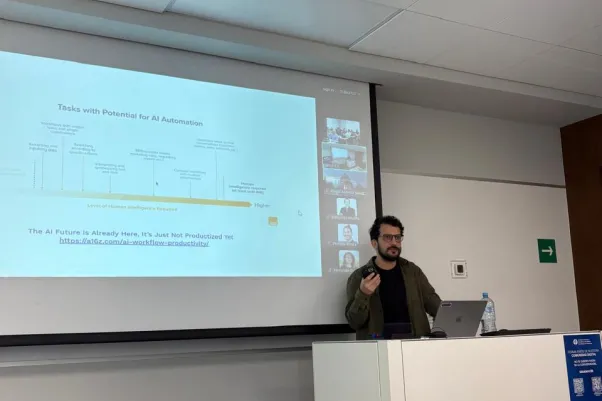

Dentro del marco de nuestros seminarios semanales, la Escuela de Gobierno y Transformación Pública recibió al Dr. Pedro Saleiro, cofundador y director de Opnova, quien presentó su ponencia titulada: Construyendo IA Agéntica Confiable: una Introducción y Retos Abiertos. En esta sesión, Pedro revisó los conceptos fundamentales de los agentes de inteligencia artificial que han dado forma a este campo durante décadas, reinterpretándolos a la luz de los modelos de lenguaje multimodal de gran escala y los avances recientes. La exposición abordó la evolución de la IA agéntica, enfocándose en sistemas capaces de planificar, utilizar herramientas, reflexionar y colaborar en entornos multiagente. Además, se discutieron los principales desafíos para garantizar la confiabilidad de estos sistemas y se sentaron las bases para futuras innovaciones en la construcción de la próxima generación de productos de inteligencia artificial.

Uno de los puntos destacados de la presentación fue el incremento significativo de publicaciones con la palabra clave "agente" en conferencias como NeurIPS desde 2019, reflejando no solo un crecimiento en la investigación académica, sino también una mayor presencia del tema en los medios. Pero también mencionó que en comparación con los años 90, la principal diferencia radica en el uso del lenguaje como vehículo para la interacción con el mundo. Los modelos de lenguaje actuales han desarrollado capacidades avanzadas como el aprendizaje en contexto, el razonamiento en cadena de pensamiento, el uso de herramientas y personalización de salidas, la descomposición de tareas, la autoevaluación y corrección, así como la percepción multimodal. Durante la charla, Pedro detalló el funcionamiento de cada una de estas capacidades y su impacto en el desarrollo de agentes inteligentes.

El seminario también abordó los riesgos emergentes en la evolución de los agentes de IA, destacando el cambio de un modelo basado en sugerencias, como los chatbots o asistentes como Copilot, hacia sistemas que ejecutan acciones de manera autónoma. Entre los riesgos más relevantes se encuentran la ampliación de la autonomía sin supervisión directa, la ejecución de acciones de largo plazo con incertidumbres estratégicas, y el acceso a herramientas, API y dispositivos. A medida que estas capacidades se expanden, existe una tendencia creciente a delegar decisiones y acciones en estos sistemas, lo que plantea desafíos en términos de confiabilidad y seguridad.

Como conclusión, Saleiro enfatizó la necesidad de desarrollar marcos de seguridad confiables, mejores mecanismos de control, sistemas de monitoreo robustos y criterios de referencia para identificar comportamientos no deseados. Entre los principales retos se mencionaron la gestión de memoria en estos agentes, la supervisión del aprendizaje continuo y la mitigación de riesgos en la selección y uso de herramientas.