El Data Pub inicia 2026 con discusión sobre productos de IA confiables y escalables

29 de Enero de 2026

El jueves 29 de enero se llevó a cabo la sesión Data Pub enero: Building trustworthy AI products that scale en la sede Mixcoac de la Escuela de Gobierno y Transformación Pública (EGobiernoyTP). El evento consistió en una charla enfocada en el desarrollo de productos de inteligencia artificial confiables y escalables, particularmente en contextos donde las decisiones automatizadas tienen implicaciones de alto impacto.

La sesión tuvo como objetivo discutir cómo construir sistemas de inteligencia artificial que generen confianza en los usuarios. En el desarrollo de estos sistemas, el enfoque tradicional suele centrarse en optimizar métricas de precisión y realizar evaluaciones exhaustivas antes del lanzamiento de un producto. No obstante, la charla destacó que la confianza de los usuarios no proviene únicamente de mejores métricas, sino también de la transparencia del sistema, del manejo adecuado de fallos y de la capacidad de los usuarios para mantener control sobre las decisiones asistidas por inteligencia artificial.

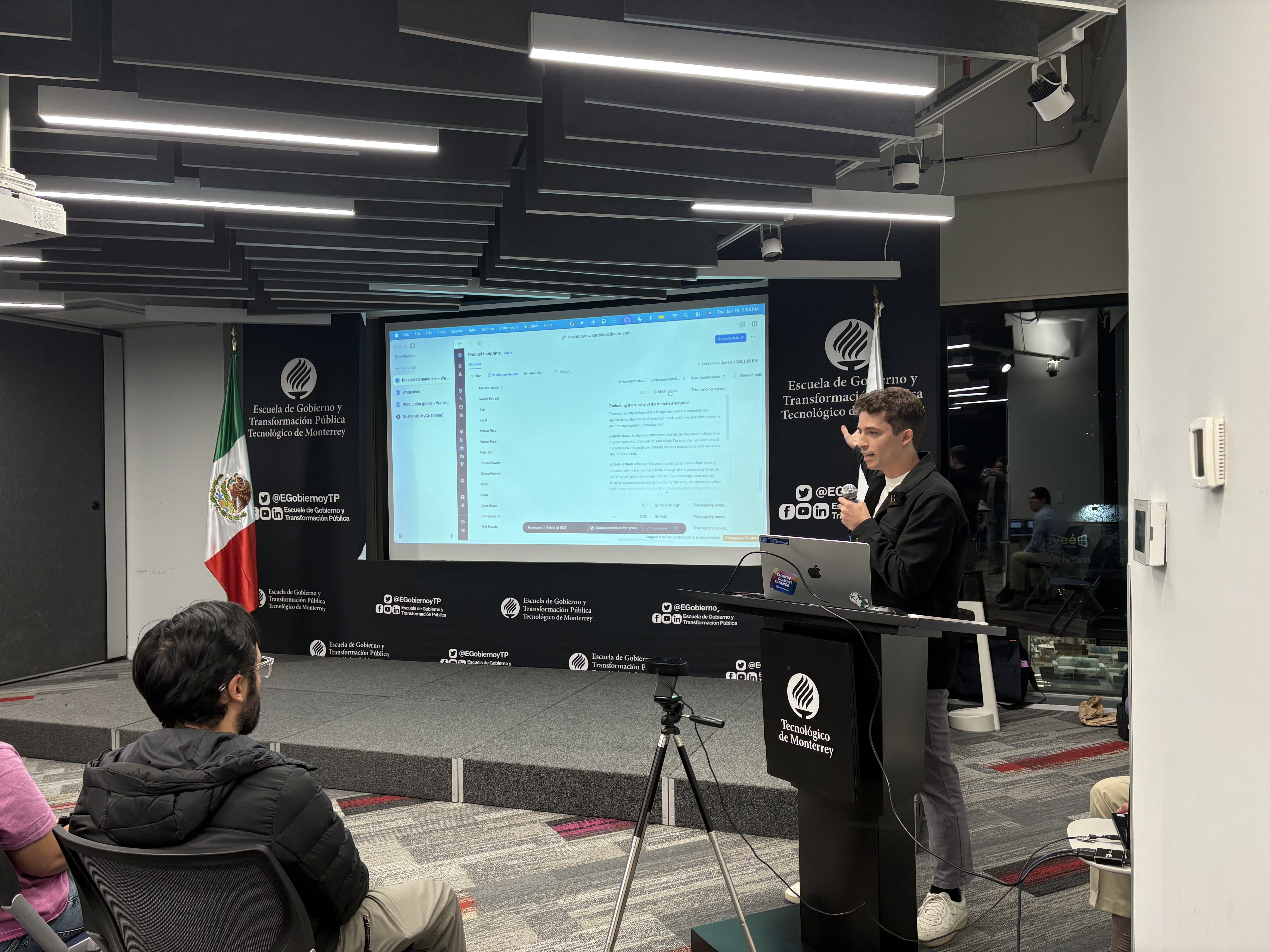

La charla fue impartida por Andrew Dumit, Lead AI Engineer en Watershed Technology. Actualmente participa en el desarrollo de la inteligencia artificial que impulsa el producto Product Footprints de Watershed, una herramienta que permite a las empresas comprender y descarbonizar las cadenas de suministro de sus productos físicos. Previamente, Andrew trabajó en el sector de health tech, donde desarrolló sistemas de inteligencia artificial y machine learningorientados a ayudar a las personas a comprender las causas de sus enfermedades. Su formación académica se basa en estadística y machine learning aplicado.

Durante la sesión se presentaron resultados derivados del desarrollo de productos de inteligencia artificial orientados a la contabilidad de la huella de carbono en cadenas de suministro. Entre los hallazgos discutidos se destacó que la confianza en el sistema permite escalar su uso y reducir significativamente la carga de trabajo manual. En particular, se mostró que al revisar manualmente solo el 30% de los emparejamientos realizados por la herramienta de clasificación de materiales es posible detectar más del 80% de los errores. Asimismo, la capacidad de la inteligencia artificial para explicar por qué asigna una baja calificación a ciertos cálculos —por ejemplo, cuando los usuarios ingresan descripciones vagas como “pieza de acero”— contribuye a mejorar la calidad de los datos introducidos por las empresas en el sistema. También se discutieron casos de uso en los que el análisis de huellas de carbono permitió a empresas explorar alternativas en sus cadenas de suministro y detectar que algunos materiales considerados “biológicos” o “ecológicos” no necesariamente generan menores emisiones debido a los procesos energéticos requeridos para su producción.

Entre los principales temas abordados se analizó el problema de las emisiones indirectas, que representan entre el 80% y el 90% de las emisiones de carbono de la mayoría de las empresas y provienen de su cadena de valor inicial. Medir estas emisiones a gran escala —cuando las compañías manejan miles o millones de productos— resulta inviable mediante métodos tradicionales basados en consultoría, por lo que se requieren herramientas apoyadas en inteligencia artificial. En este contexto, se explicó el uso de sistemas de IA multiagente para tareas como el auto mapping, que empareja materiales de una empresa con bases de datos de factores de emisión, así como la generación automatizada de huellas de producto mediante la creación de “gemelos digitales” de cadenas de suministro complejas, como las de prendas de mezclilla. Finalmente, se presentaron tres principios para construir confianza en productos de IA: detectar fallas catastróficas a tiempo mediante validaciones deterministas, diseñar mecanismos de explicabilidad con “divulgación progresiva” que permitan a los usuarios profundizar en el razonamiento del sistema, y desarrollar interfaces que integren al usuario humano en el proceso de revisión y auditoría.

Este tipo de espacios académicos contribuyen a analizar el desarrollo responsable de tecnologías emergentes y se alinean con la misión de la Escuela de Gobierno y Transformación Pública de generar conocimiento aplicado y promover soluciones innovadoras a problemas públicos desde una perspectiva multidisciplinaria.